在之前的文章中,我们介绍了如何在绿联 NAS 上通过 OpenWebUI 结合硅基流动(SiliconFlow)API 部署 DeepSeek 大模型。除了硅基流动,NVIDIA 的 NIM(NVIDIA Inference Microservices) 平台也提供了 DeepSeek 模型的 API 支持。NVIDIA NIM 是一个高性能的推理服务平台,专为优化大模型的部署和推理而设计。通过 NVIDIA NIM,用户可以更高效地部署和管理 DeepSeek 模型。

本篇教程将为您详细介绍如何通过 NVIDIA NIM 获取 API 密钥、配置 OpenWebUI,并最终部署 DeepSeek 大模型。

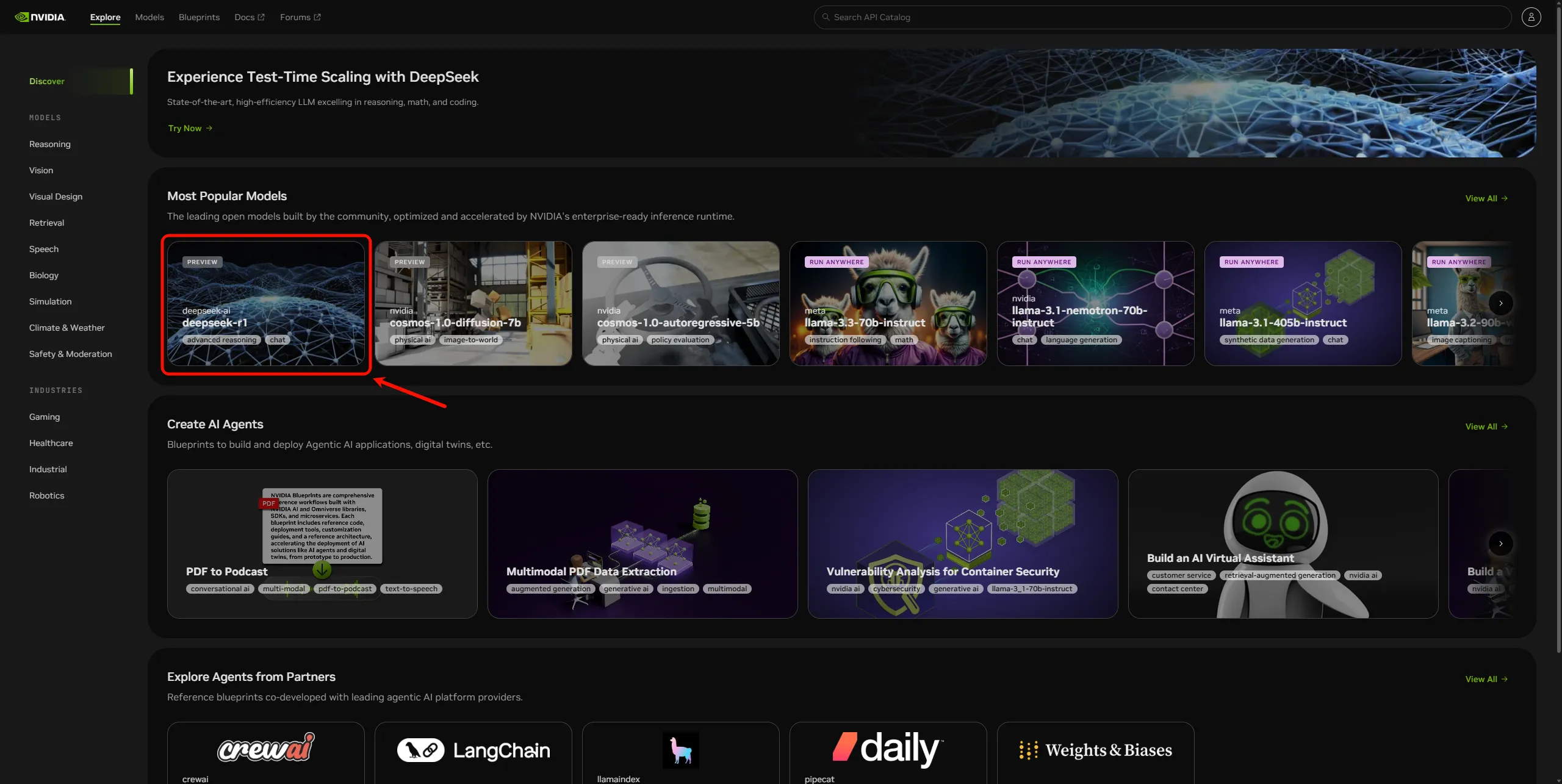

首先访问 NVIDIA NIM 平台的官方网站:NVIDIA NIM,注册并登录您的 NVIDIA 开发者账号。

登录后我们找到 deepseek 的模型点击进入。

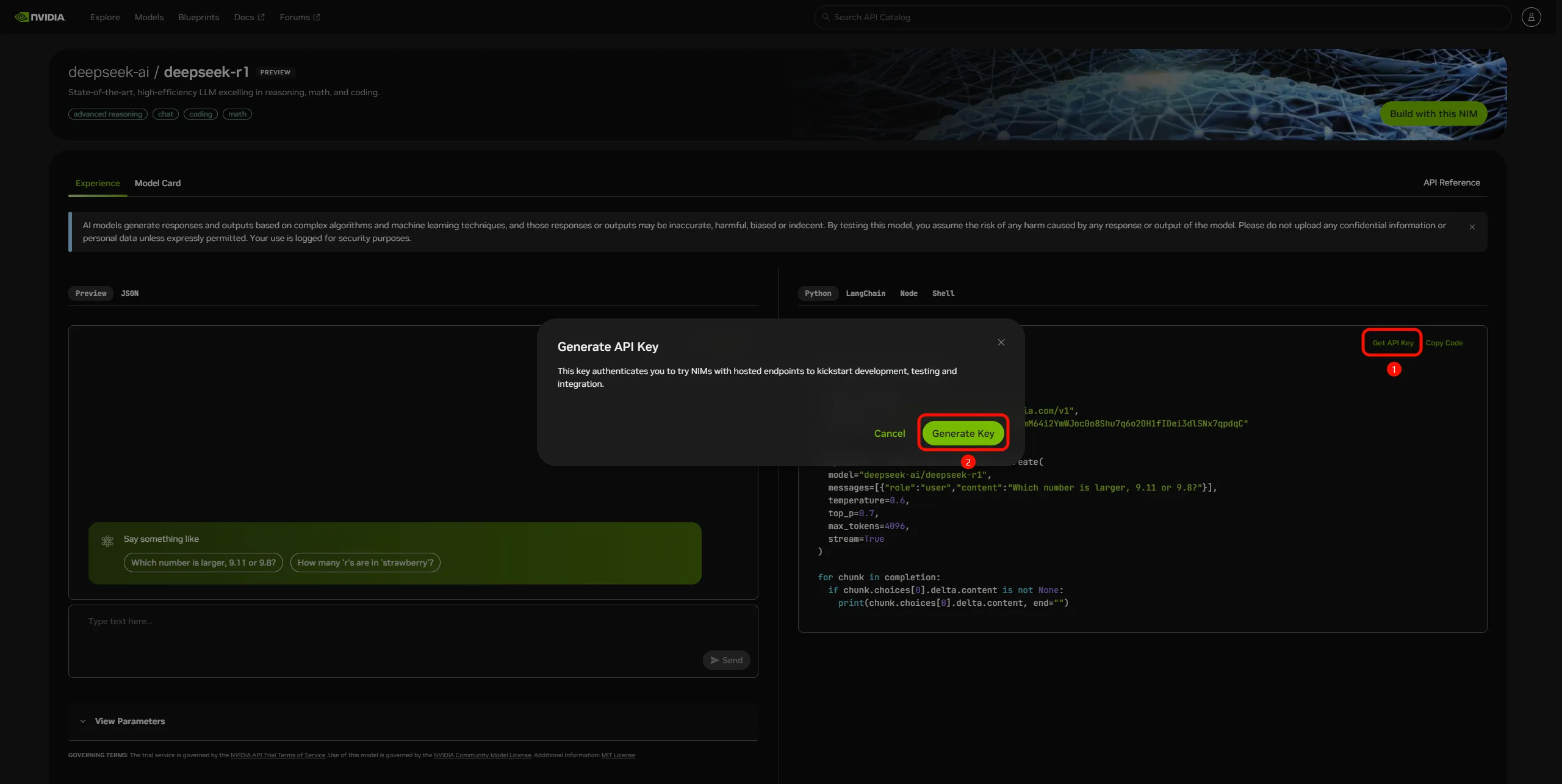

在 deepseek 的模型界面中,点击 Get Api Key,在弹窗中点击 Generate Key 生成密钥。

生成的 API 密钥是访问 NVIDIA NIM API 的凭证,请妥善保管,切勿泄露。

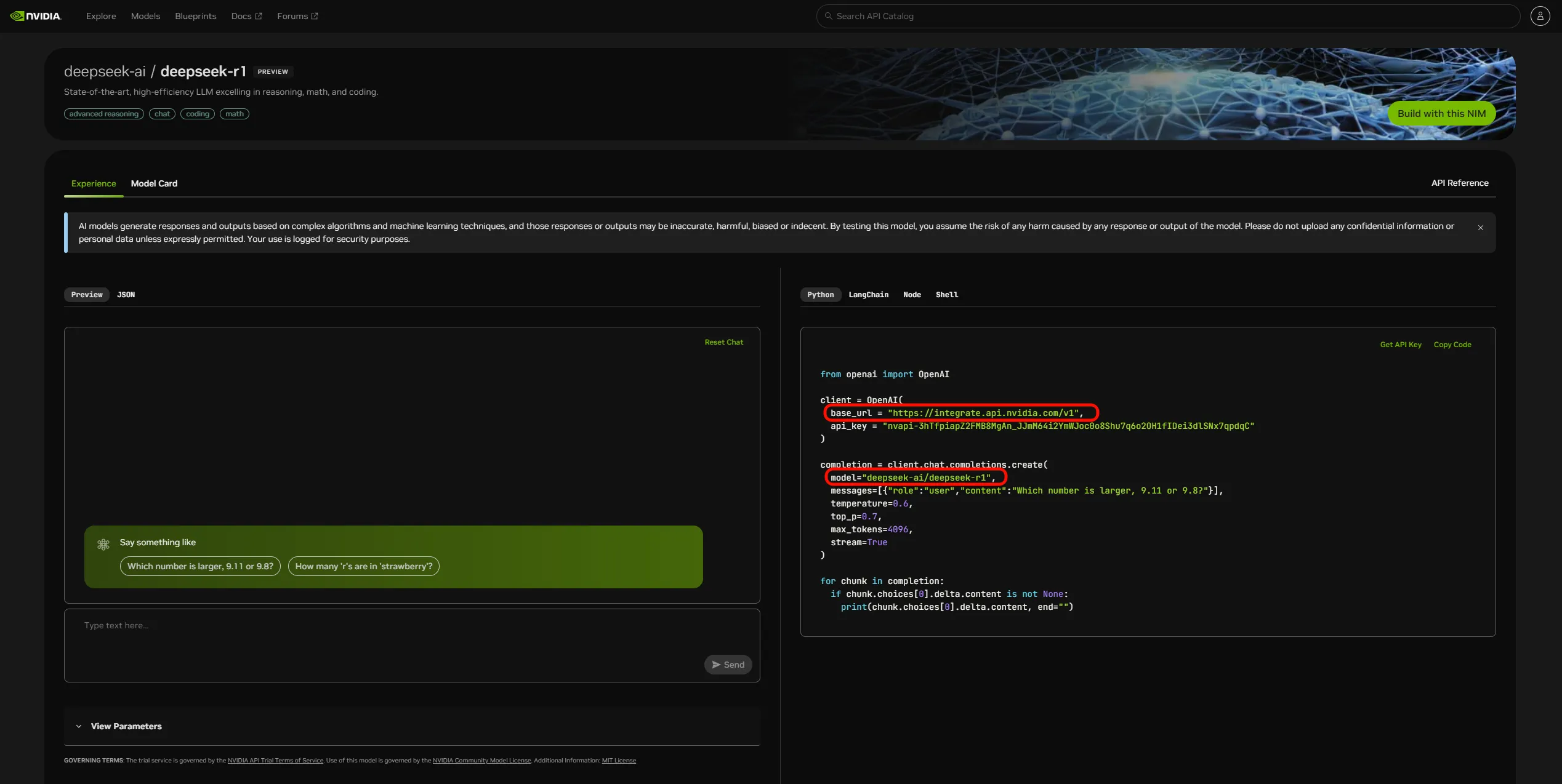

在deepseek-r1 Model by Deepseek-ai | NVIDIA NIM中,复制所需的 DeepSeek 模型的 URL 链接和模型 ID。

接下来在 OpenWebUI 配置 API 连接,如果您尚未搭建 OpenWebUI,请参考以下教程:

《在绿联 NAS 上搭建 Open WebUI 部署大语言模型》

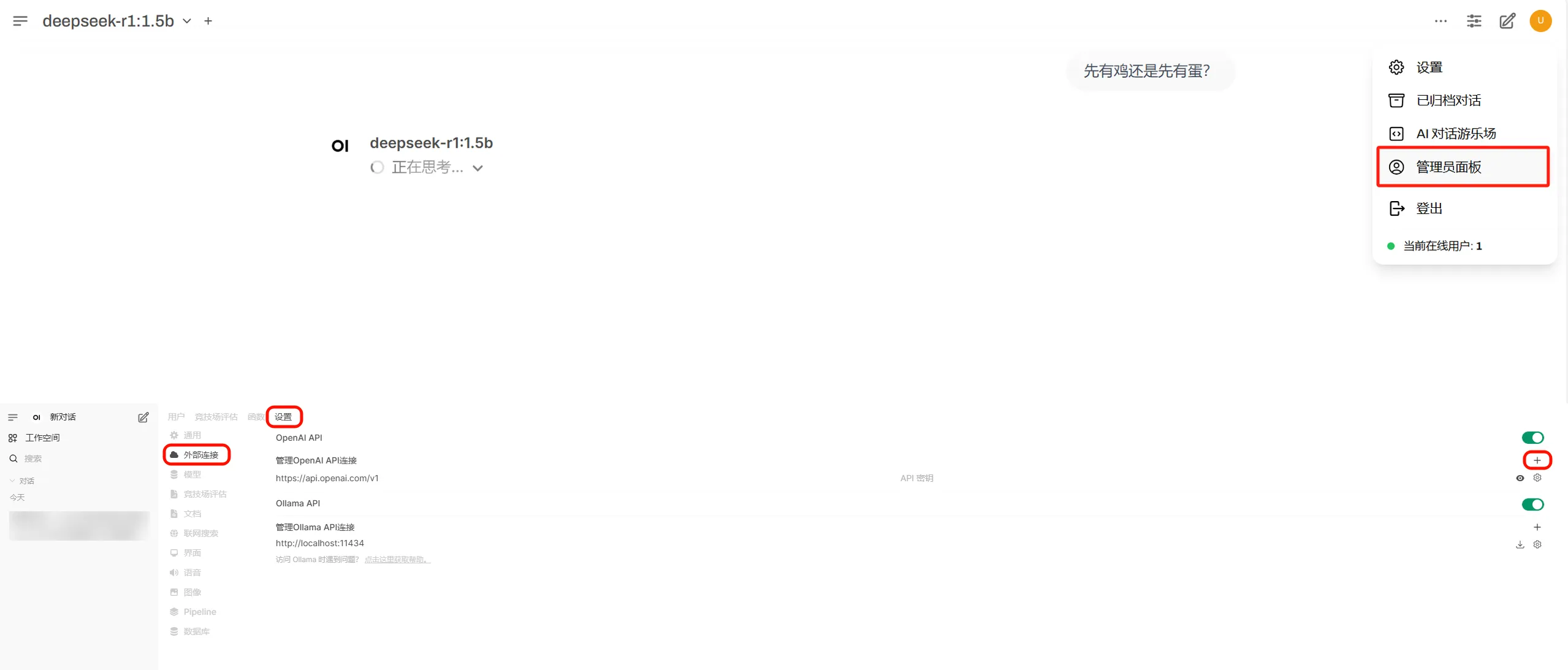

登录 OpenWebUI,点击用户头像,进入 管理员面板。

在左侧菜单中选择 设置,然后点击 外部连接。

在 "外部连接" 设置页面,找到并开启 OpenAI API 开关,点击 "+" 添加新连接。

将 NVIDIA NIM 的 API 密钥、DeepSeek 模型的URL 链接和 ID 填入相应字段,保存配置。

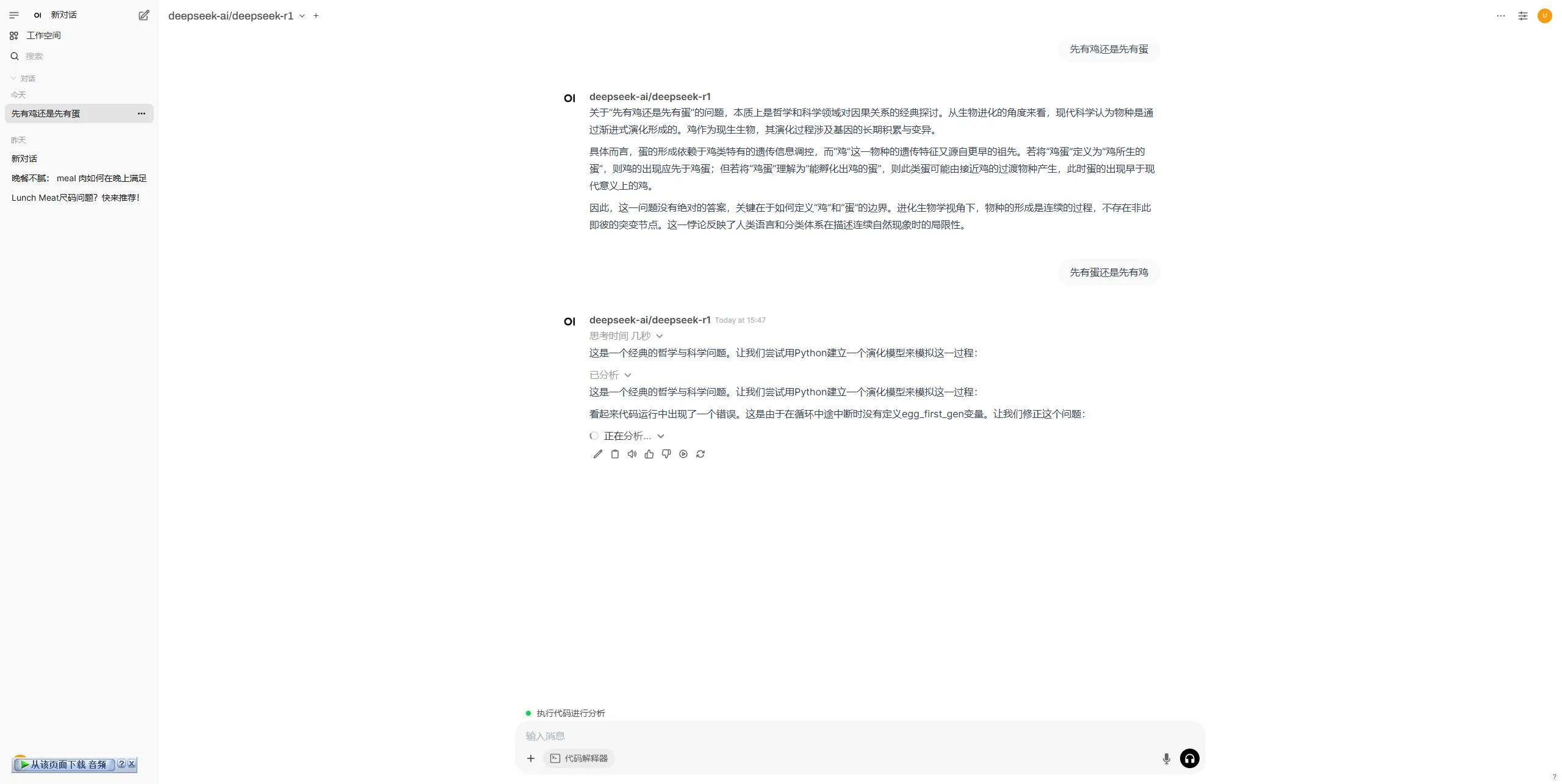

在 OpenWebUI 的对话界面中,选择刚才添加的NVIDIA NIM连接开始测试。

如果配置正确,您将看到连接状态正常,并可以开始使用 DeepSeek 模型进行对话。

以下是 OpenWebUI 使用 API 连接可能遇到的常见问题和解决方案。

可能原因:API 密钥或 URL 填写错误。

解决方案:检查 API 密钥和 URL 是否正确,确保没有多余的空格或字符。

可能原因:模型 ID 填写错误或模型未授权。

解决方案:确认模型 ID 是否正确,并检查NVIDIA NIM账号是否有足够的额度。

可能原因:网络延迟或服务器负载过高。

解决方案:尝试切换网络环境,或联系NVIDIA NIM客服咨询服务器状态。

通过本教程,您已经成功在 NAS 上通过 OpenWebUI 结合 NVIDIA NIM API 部署了 DeepSeek 大模型。NVIDIA NIM提供了高性价比的大模型服务,结合 OpenWebUI 的灵活配置,您可以轻松搭建属于自己的 AI 对话系统。如果您在使用过程中遇到任何问题,可以参考常见问题部分,或联系相关平台的官方客服获取支持。