AI Plugins 是一个基于容器化技术构建的一站式大模型应用,深度整合了 Open WebUI、Ollama 和 IPEX-LLM 三大核心组件。它不仅提供了便捷的用户界面,还通过调用 Intel GPU 的硬件加速能力,显著提升大语言模型的运行效率。

技术优势对比

DXP4800 Plus

DXP6800 Plus

DXP6800 Pro

DXP8800

DXP8800 Plus

DXP8800 Pro

DXP480T Plus

注意事项:

运行大模型需要较强的硬件支持,推理过程中可能会影响系统其他软件的使用。

安装过程较长,且安装过程中不能取消,请耐心等待。

选择 Ollama 模型时,请根据 NAS 的内存大小来决定使用哪个版本,以确保模型能正常运行。具体建议如下:

8GB 内存:使用 2B 或更小的模型。

16GB 内存:使用 8B 或更小的模型。

32GB 内存:使用 14B 或更小的模型。

内存越大,可以支持的模型也越大。合理选择模型规模和硬件资源,不仅能充分利用硬件,还能确保模型在推理或训练时表现最佳,同时保证客户端和其他应用可以正常运行。

在实际部署时,还需要考虑其他因素(如 I/O 性能、并发负载等),以进一步提升系统整体性能。

默认访问端口:13888

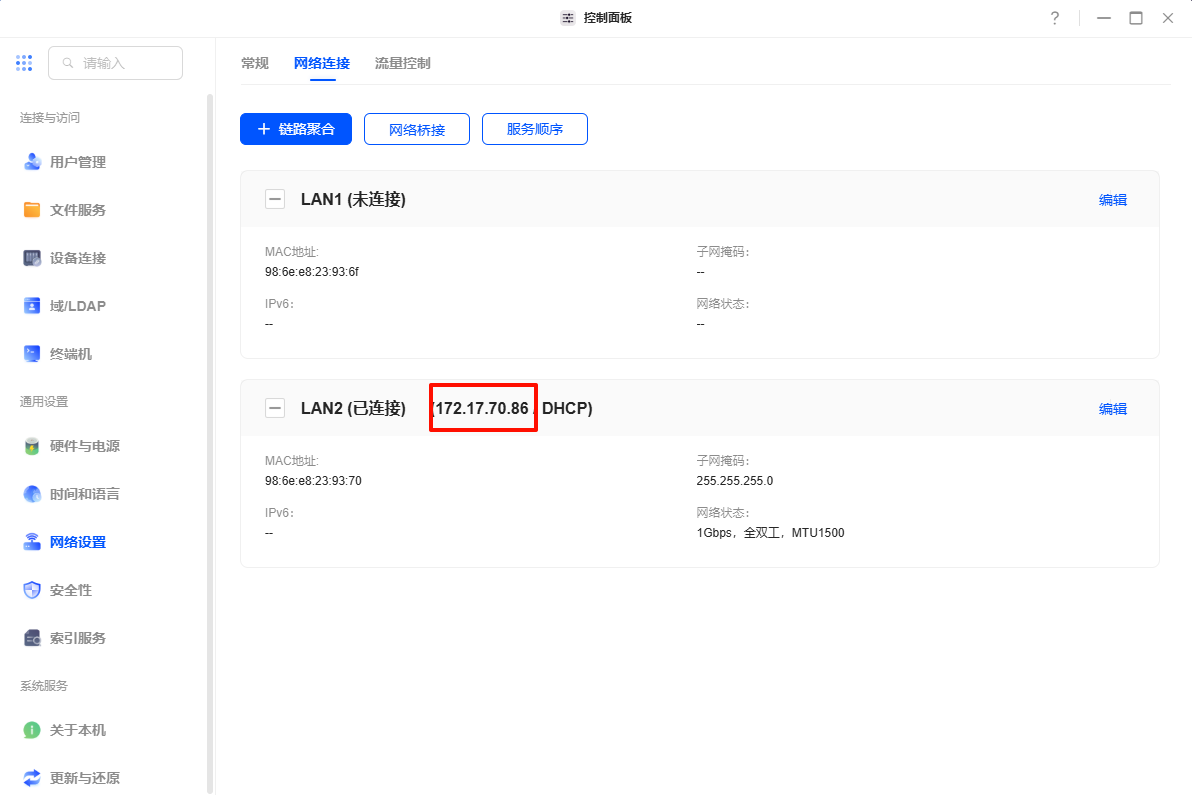

局域网访问:在浏览器地址栏输入 http://NAS_IP:13888。例如 NAS 的 IP 是172.17.70.86,在浏览器中输入http://172.17.70.86:13888进行访问。

请注意:

你可以在控制面板中,找到 网络设置,点击 网络连接,查看 NAS 设备的 IP 地址。

请勿修改 WebUI 的端口号,避免因修改导致管理员通过 UGOS Pro 应用中心图标跳转功能失效。

安装 AI Plugins 应用,请按以下步骤操作:

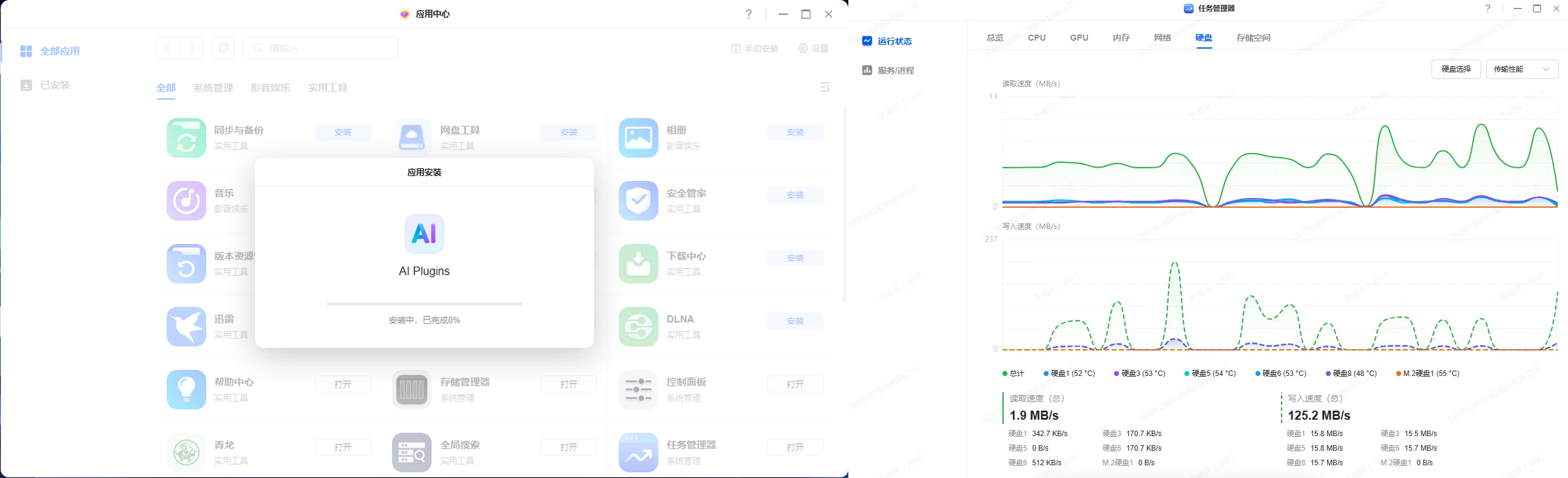

打开【应用中心】找到 AI Plugins 应用,点击“安装”。

选择存储空间,点击“安装”继续。

如果在安装过程中,发现安装进度条似乎没有变化,不要担心。这是由于安装程序正在后台进行必要的初始化工作。你可以按照以下步骤检查安装状态:

打开“任务管理器”应用。

在任务管理器中,切换到【运行状态】选项,点击【硬盘】查看当前的硬盘读写状态。

如果磁盘显示有读写活动,说明安装程序仍在运行。由于该套件较大,安装过程可能需要较长时间。

请注意:安装过程中无法取消操作,请耐心等待,直到安装完成。

你可以通过以下方法访问 AI Plugins 应用:

在局域网内,管理员点击“AI Plugins”应用图标,系统将跳转至登录界面。

在局域网内使用http://NAS_IP:13888访问。例如 NAS 的 IP 是172.17.70.86,在浏览器中输入http://172.17.70.86:13888进行访问。

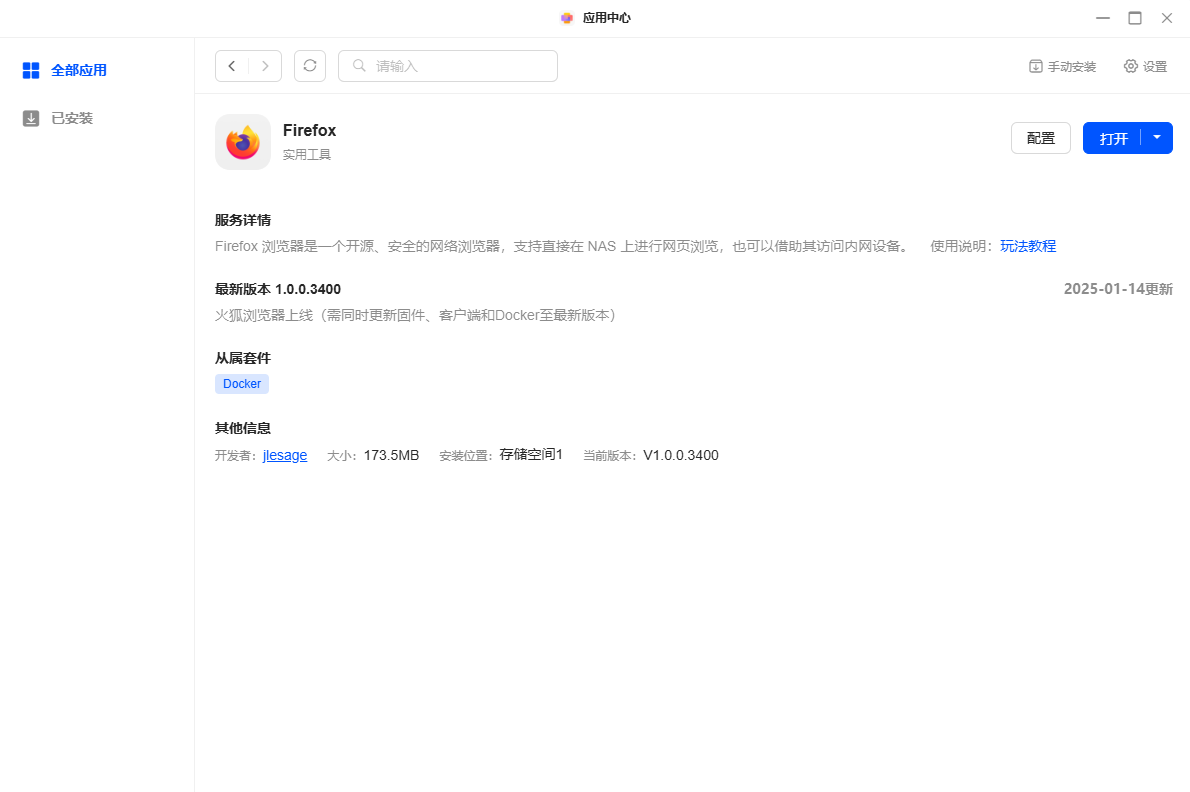

管理员可以通过在 UGOS Pro 系统安装的 Firefox 应用在非局域网环境中访问 AI Plugins:

使用 UGREEN Link 登录 NAS,打开 Firefox 应用。

登录 Firefox 后,使用http://NAS_IP:13888访问。例如 NAS 的 IP 是172.17.70.86,在浏览器地址栏中输入http://172.17.70.86:13888进行访问。

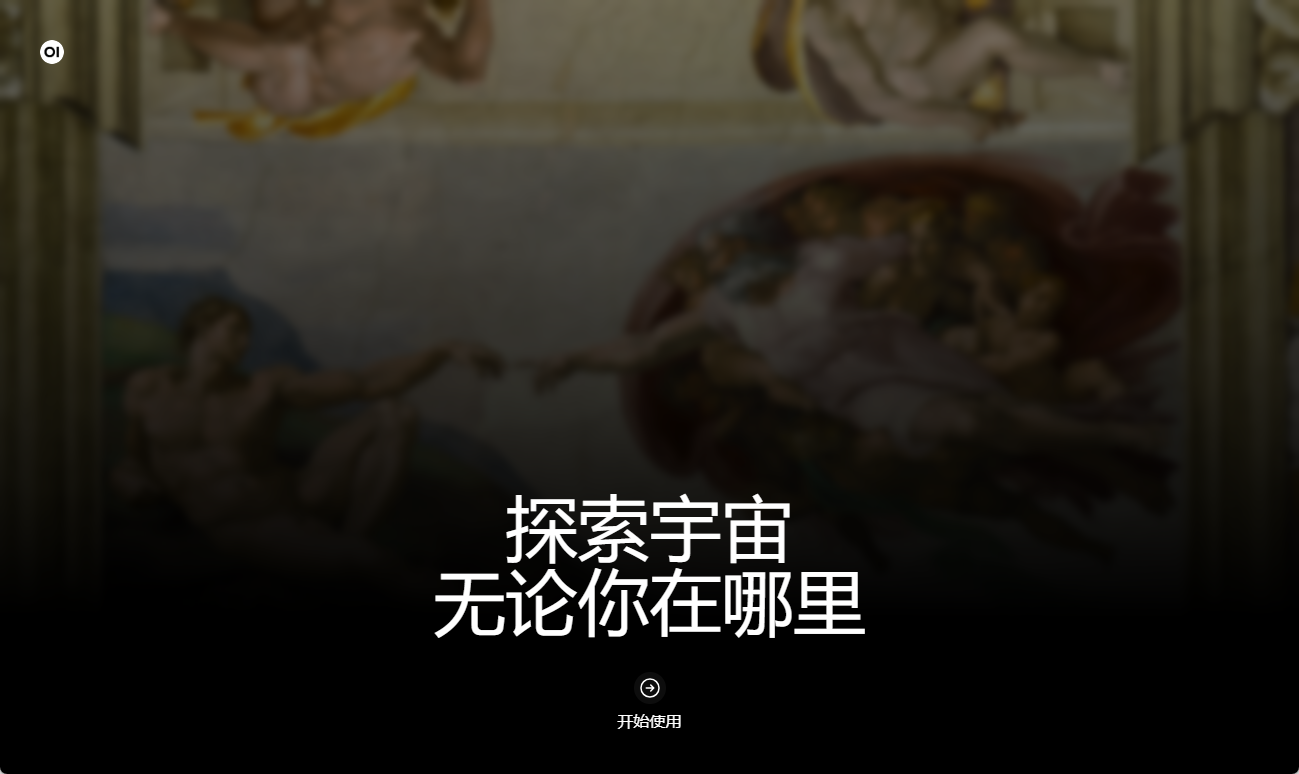

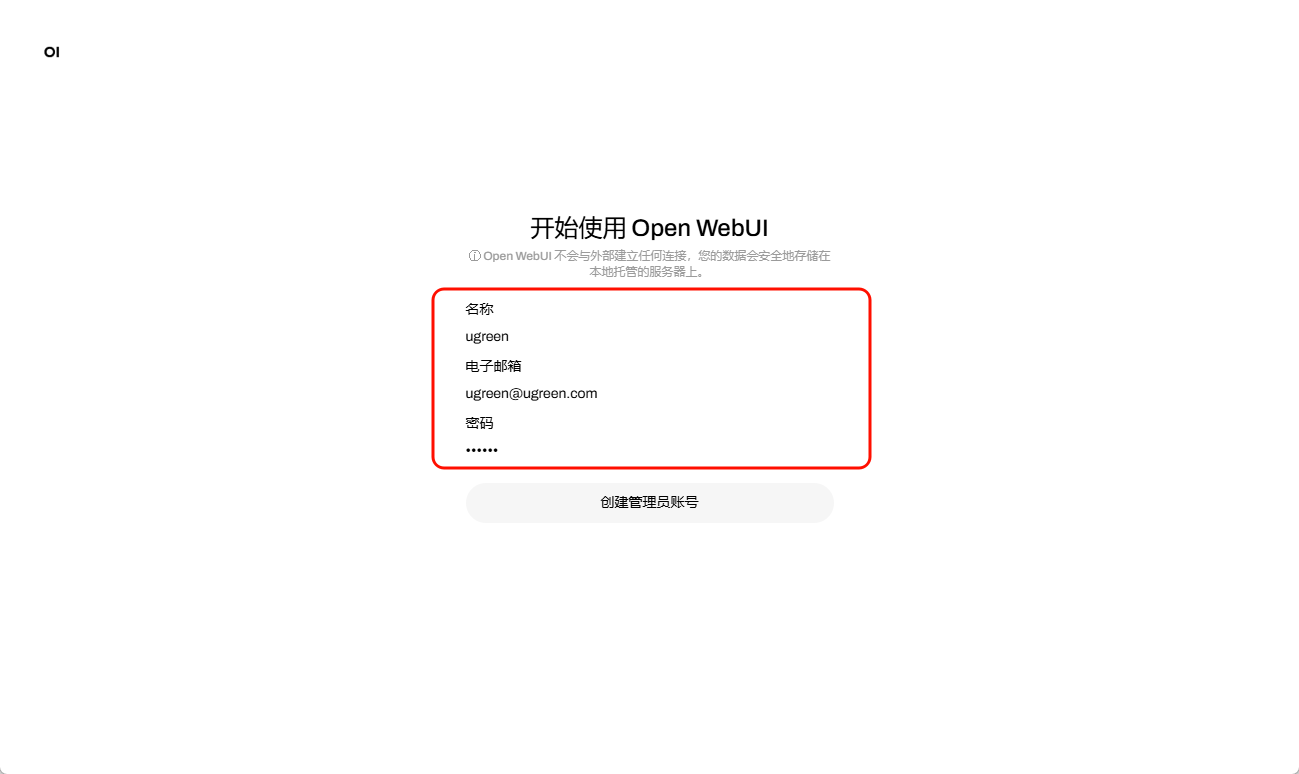

首次使用 AI Plugins 时,需要完成初始化配置:

点击“开始使用”继续。

填写登录用户的名称、邮箱及密码,点击“创建管理员账号”完成创建流程。

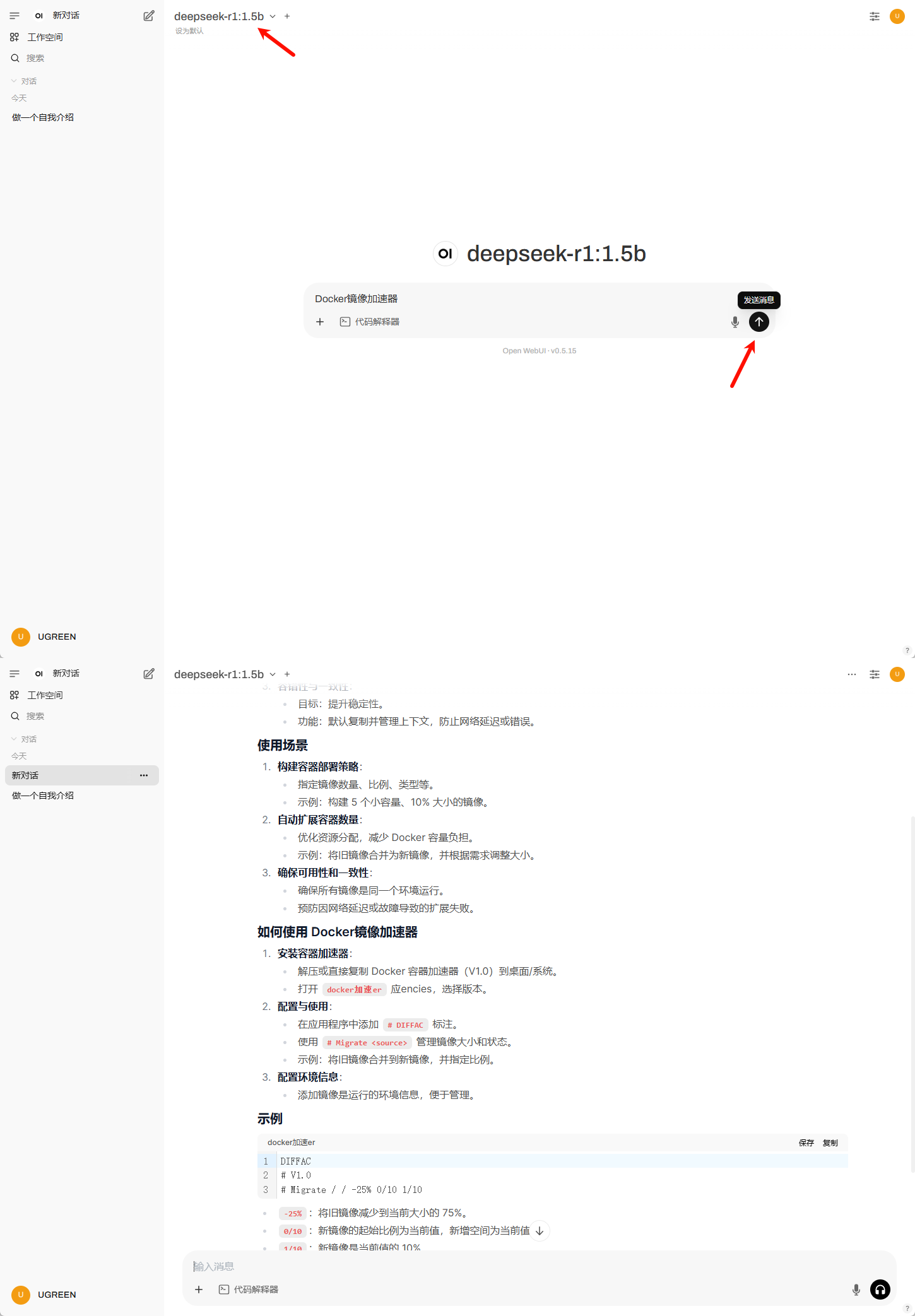

应用默认内置了 deepseek-r1:1.5b 模型,使用方法请按照以下步骤操作:

点击【新对话】。

选择内置的模型。

在对话框中输入问题,点击【发送消息】按钮,就可以开始使用模型了。

补充说明:

在 NAS 设备上运行 Open WebUI 容器时,默认情况下是靠 Intel 的 CPU 来完成计算任务的。但绿联 NAS 的 AI Plugins 应用通过引入 IPEX-LLM 技术,可以让 Intel 的 GPU 也参与计算,从而加速处理速度。相比过去只依赖 CPU 的方式,这种方法效率更高、性能更好。

以下是一些常见的大语言模型及其版本,仅供参考:

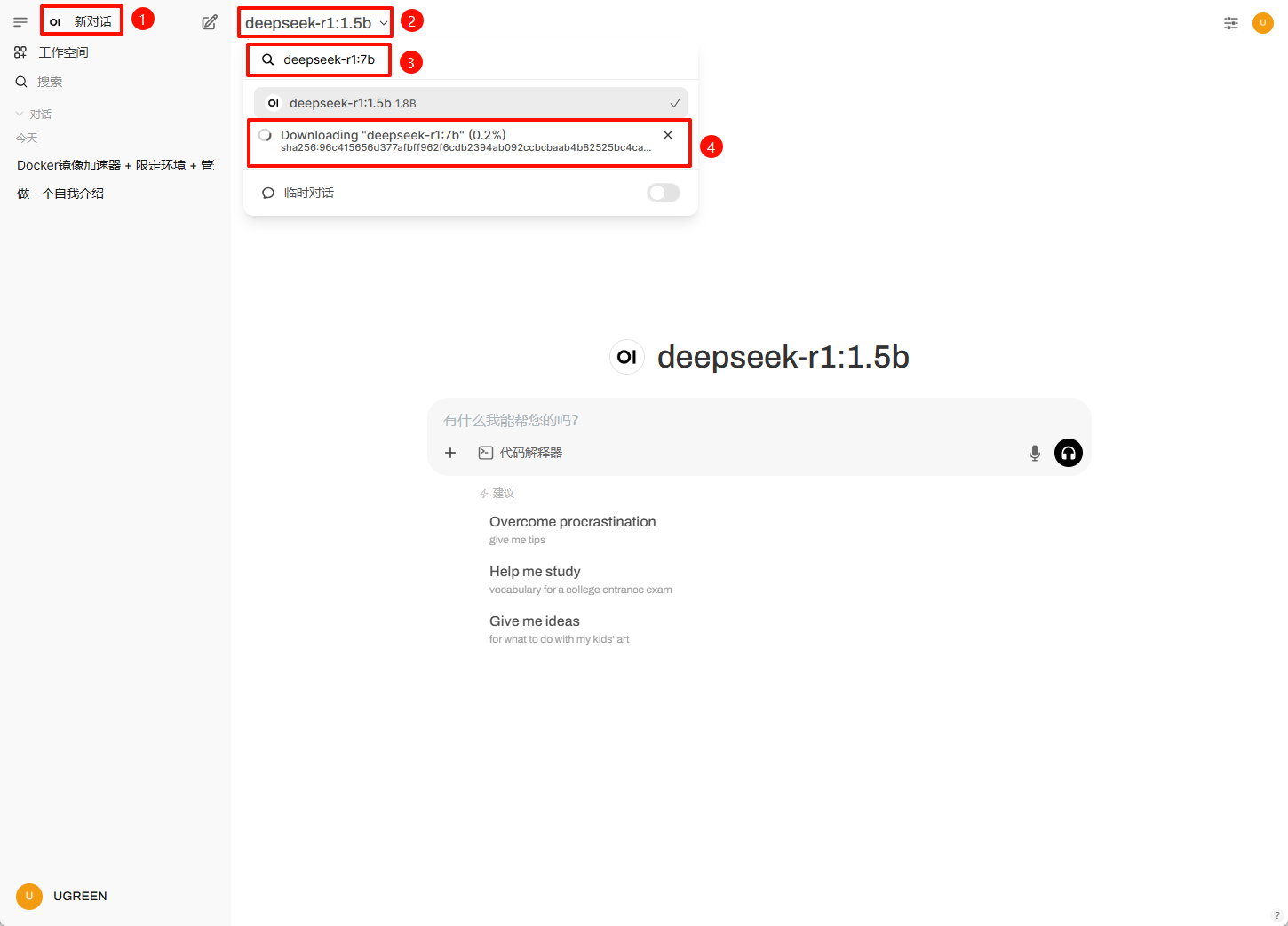

复制需要下载的模型名称后,回到 AI Plugins 中,点击【新对话】,进入交互界面。

点击顶部模型名称展开列表。

在搜索栏粘贴目标模型的下载命令(如deepseek-r1:7b)。

点击【从 Ollama.com 拉取 "deepseek-r1:7b"】启动下载。在模型列表可以看到下载进度,等待下载完成即可。

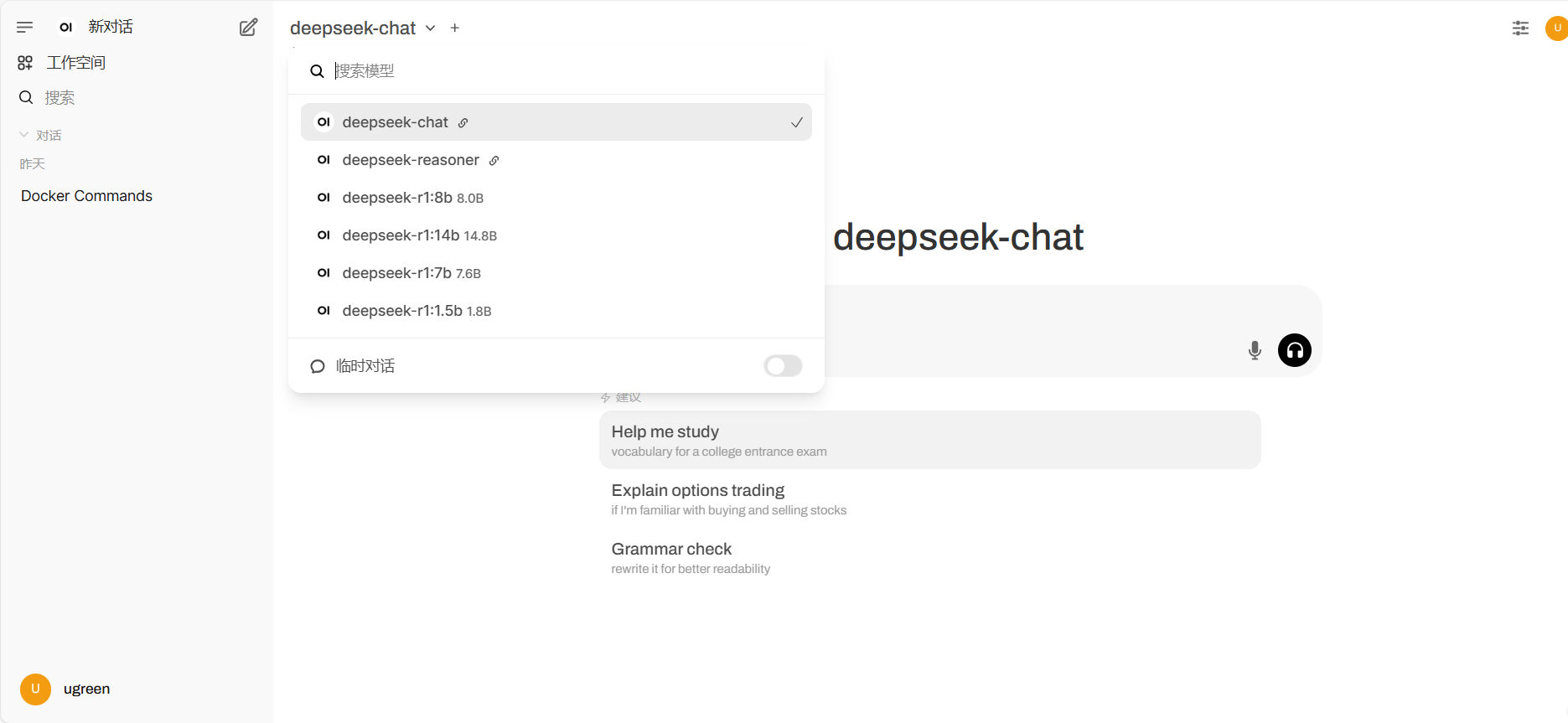

模型下载完成后,顶部模型名称展开列表,切换刚刚下载好的模型。

在对话框中输入问题,点击【发送消息】按钮,就可以开始使用模型了。

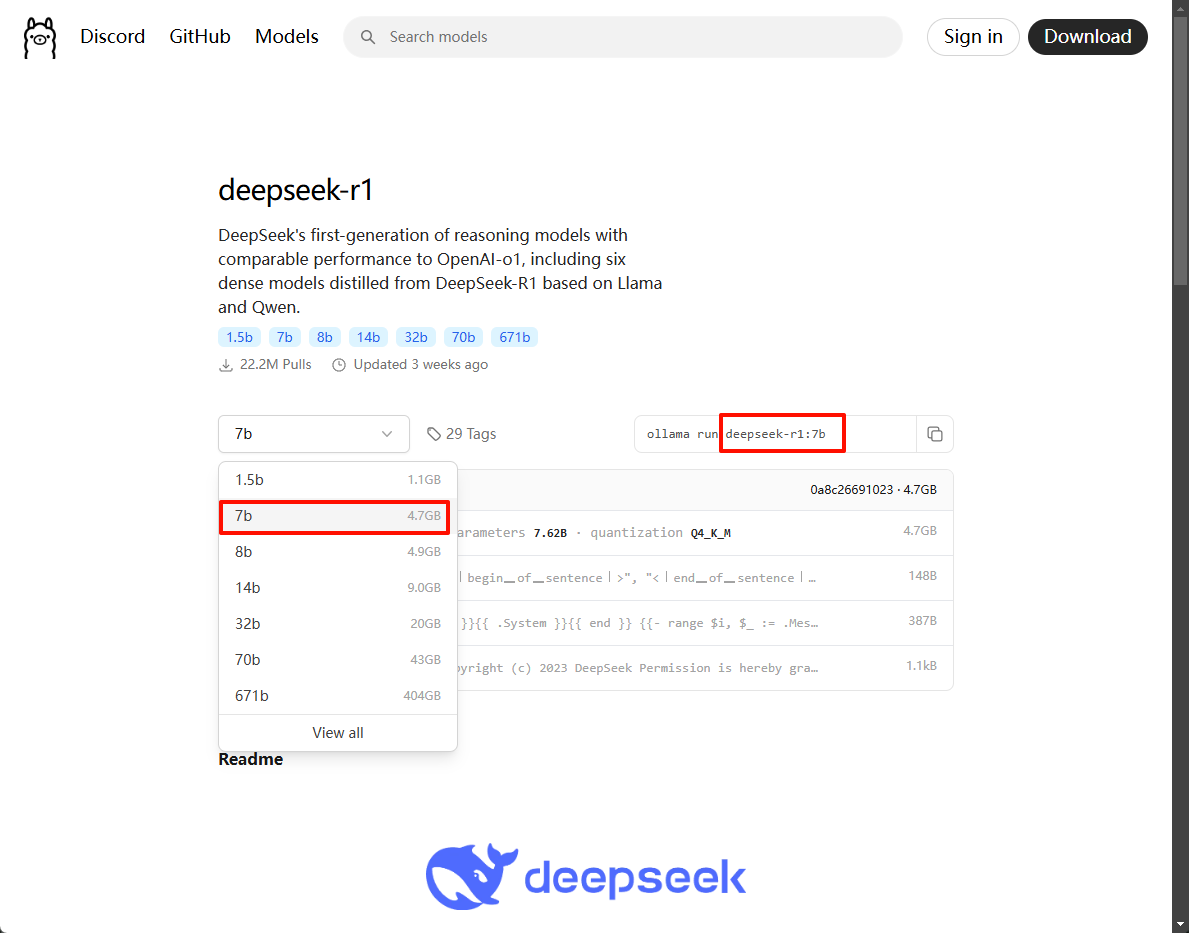

如果你想使用 Ollama 模型库中的其他模型,可以按照以下步骤操作:

访问 Ollama 官方模型库这里列出了所有可用的模型。

在搜索框中输入你想找的模型名称,比如 deepseek-r1然后点击进入该模型的页面。

在模型页面上,你会看到这个模型的不同版本(比如 1.5b、7b、8b 等)。选择你需要的版本,然后复制完整的模型名称,例如 deepseek-r1:7b 或 deepseek-r1:8b。

如果需要其他版本,重复上述步骤即可。

为了确保你在使用NAS设备及相关应用时获得最佳体验并保障数据安全,请注意以下几点:

在局域网内访问NAS时,推荐使用Chrome浏览器,以获得更稳定和流畅的体验。

在不受信任设备或公共网络中登录 NAS 后,请及时清理浏览器缓存、Cookie及历史记录,防止数据泄露。

定期更换复杂密码,强化访问安全性,避免未授权访问风险。

多人共用设备(如 NAS 的 Firefox 应用)访问NAS时,建议关闭“自动记住密码”功能,并定期清理浏览记录,保障账户安全。

避免迁移、重命名或删除容器挂载的 NAS 文件夹路径,以免引发功能异常或数据丢失。

通过浏览器访问容器应用时,请打开“控制面板”应用,关闭【网络管理】中的多网关选项,规避网络冲突。

容器应用适合新手用户使用,但若需更灵活配置,建议直接使用Docker部署,以便自定义配置文件及高级功能。